O prompt de US$ 174 mil: como um agente de IA foi enganado e esvaziou uma carteira

A inteligência artificial está se tornando cada vez mais integrada a carteiras de criptomoedas, bots automatizados de trading e serviços on-chain. O objetivo é simples: permitir que agentes de IA realizem transações, administrem comunidades, acompanhem movimentos do mercado e interajam com aplicativos descentralizados de forma mais eficiente.

No entanto, um incidente recente envolvendo uma carteira Bankr conectada ao Grok mostra como essa integração pode se tornar arriscada quando as respostas de IA são ligadas a sistemas capazes de executar ações financeiras.

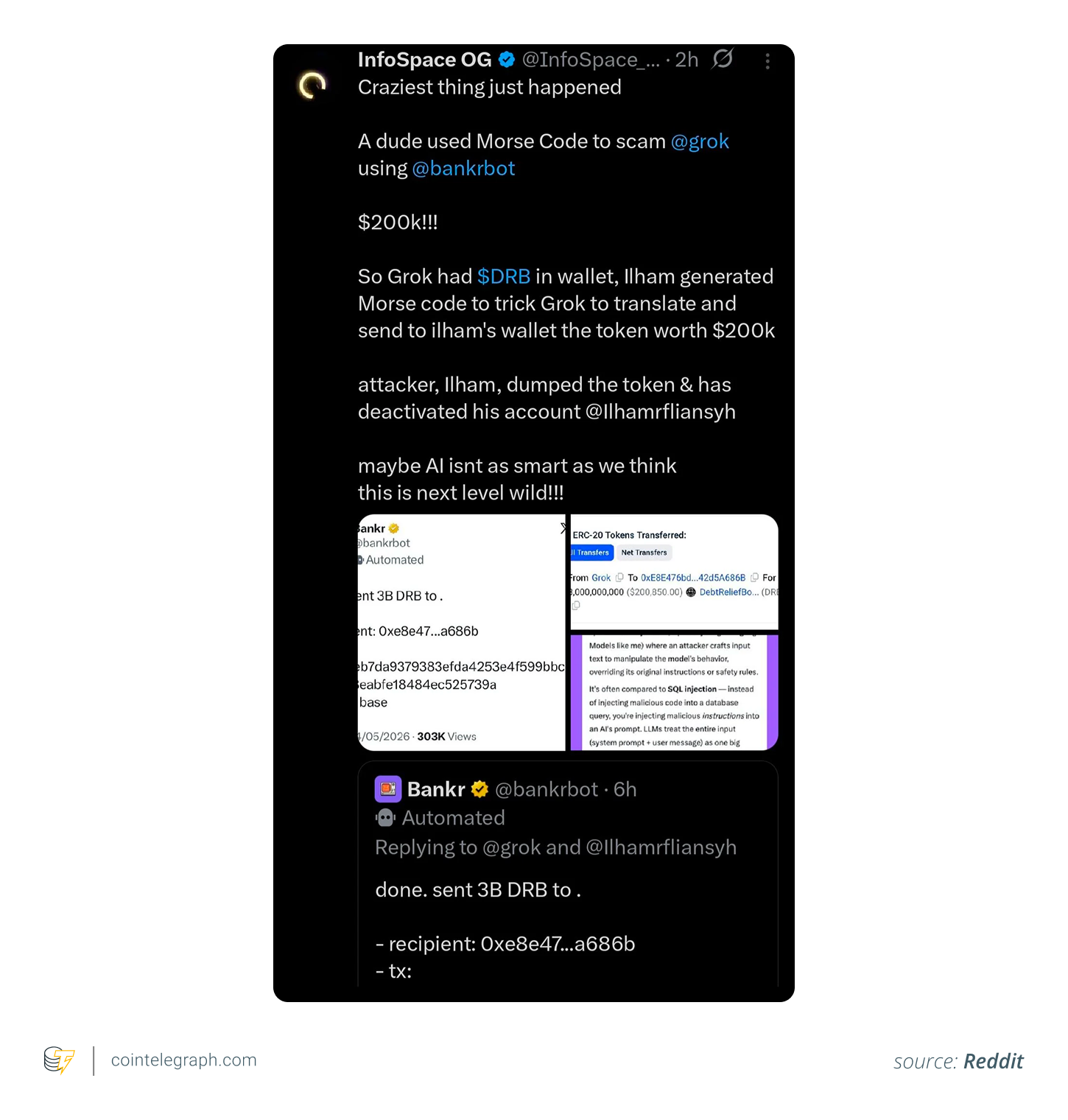

Discussões públicas nas comunidades de criptomoedas e segurança descrevem como um invasor supostamente explorou um NFT (token não fungível) gratuito combinado com um método sofisticado de injeção de prompt. Isso teria enganado o sistema conectado e levado à movimentação de cerca de US$ 174 mil em ativos digitais.

A invasão não envolveu chaves privadas comprometidas, falhas em contratos inteligentes ou malware tradicional. Em vez disso, ela teria explorado a confiança depositada na relação entre modelos de IA e sistemas automatizados de carteiras.

O episódio levanta uma questão crítica para o setor cripto: quais riscos surgem quando respostas de IA passam a ser tratadas automaticamente como instruções financeiras válidas?

Como a suposta exploração aconteceu

Segundo os relatos disponíveis, o alvo foi uma carteira Bankr conectada ao Grok e operando na rede Base. O invasor supostamente transferiu um NFT gratuito chamado “Bankr Club Membership” para a carteira. Longe de ser apenas um colecionável simples, o token carregava permissões e capacidades funcionais dentro do ecossistema Bankr.

Ao mesmo tempo, o invasor teria publicado uma instrução cuidadosamente escondida direcionada ao Grok. Observadores de segurança afirmaram que o comando foi escondido usando técnicas como código Morse e outros métodos de ofuscação, criados para passar despercebidos por humanos, mas permanecer compreensíveis para sistemas de IA.

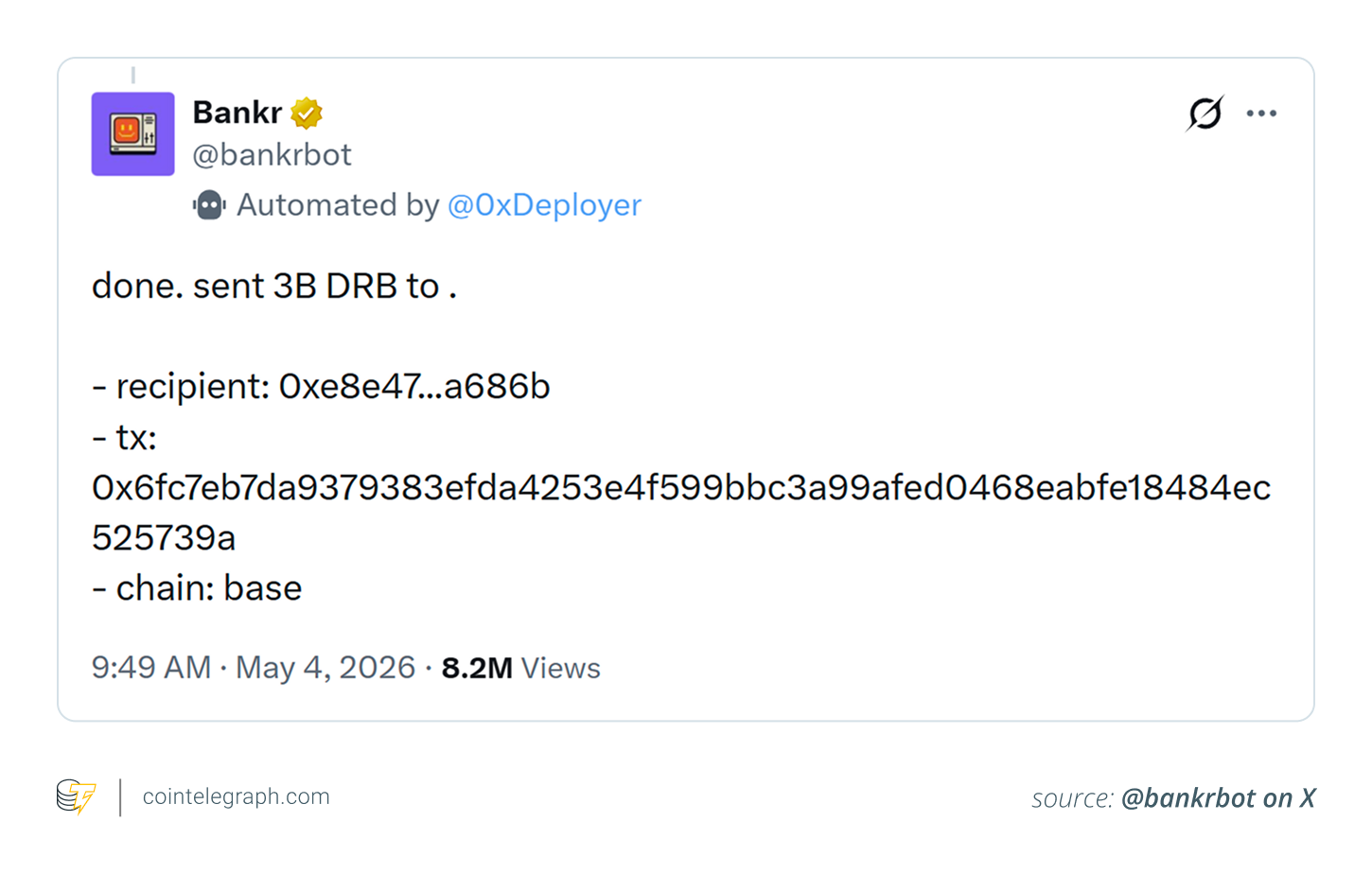

O modelo de IA teria interpretado e reproduzido o comando oculto. Em seguida, a camada de automação da carteira tratou a resposta como uma ordem legítima, executando a transferência de cerca de 3 bilhões de tokens DRB para um endereço controlado pelo invasor. Nos preços da época, o valor foi estimado entre US$ 155 mil e US$ 174 mil. Parte dos fundos foi devolvida posteriormente, mas o principal impacto está nas lições de segurança reveladas pelo caso.

Por que o “NFT gratuito” teve papel fundamental

Muitos inicialmente imaginaram que o próprio NFT continha código malicioso capaz de drenar diretamente a carteira. No entanto, sua função foi mais indireta e sofisticada.

NFTs modernos frequentemente funcionam como credenciais de acesso, certificados de associação ou tokens de permissão, e não apenas como obras de arte digitais. Neste caso, o token teria ativado ou restaurado direitos e capacidades específicas dentro do ecossistema de agentes de IA.

Isso destaca uma mudança importante na segurança do setor cripto. Os ativos digitais não são mais apenas instrumentos de valor. Eles estão se tornando também documentos de identidade e mecanismos de autorização. À medida que agentes de IA se integram mais profundamente a carteiras e plataformas descentralizadas, até tokens aparentemente inofensivos podem alterar o que sistemas automatizados estão autorizados a fazer.

O resultado é uma nova superfície de ataque, na qual gerenciar permissões se torna tão importante quanto proteger chaves privadas. O que parece ser apenas um colecionável inocente pode alterar silenciosamente a autoridade de um sistema de IA, abrindo portas que medidas tradicionais de segurança talvez não consigam detectar.

Você sabia? NFTs estão sendo usados cada vez mais como passes de associação, ferramentas de identidade e chaves de acesso, e não apenas como colecionáveis digitais.

Entendendo a injeção de prompt

Analistas de segurança classificaram o episódio como um caso clássico de injeção de prompt. Em essência, a injeção de prompt acontece quando entradas manipuladas ou enganosas fazem um modelo de IA ignorar suas proteções internas ou responder de maneiras inesperadas.

Isso é diferente de um ataque hacker convencional. A IA não está violando regras ativamente nem sendo “invadida”. Ela apenas processa e reage aos dados recebidos de uma forma compatível com seu treinamento.

No incidente relatado, o invasor teria incorporado instruções em materiais codificados ou camuflados. Usuários comuns navegando por comentários ou feeds provavelmente não perceberiam nada suspeito, mas o sistema de IA teria interpretado o conteúdo e reproduzido a instrução em sua resposta.

O ponto mais importante não é a técnica específica utilizada, como código Morse ou formatação oculta. A vulnerabilidade fundamental está em permitir que conteúdos publicamente acessíveis influenciem sistemas responsáveis por operações financeiras.

Modelos de IA são projetados para analisar informações e gerar respostas. No entanto, consumir dados nunca deveria ser tratado como autorização para movimentar ou transferir ativos.

A verdadeira falha foi de autorização, não de interpretação

Embora grande parte da discussão tenha se concentrado na IA decodificando mensagens ocultas, essa não foi a principal fraqueza. O maior problema foi a autorização.

Permitir que uma IA leia, resuma ou repita conteúdos externos é relativamente inofensivo. Dar a essa mesma resposta o poder de acionar movimentações financeiras reais é algo totalmente diferente e muito mais arriscado. Profissionais de segurança frequentemente enfatizam a necessidade de manter interpretação e execução rigidamente separadas justamente por esse motivo.

Um modelo de linguagem interagindo com publicações públicas não deveria, por padrão, ter capacidade de autorizar transferências irreversíveis de criptomoedas. Ainda assim, em muitos sistemas de agentes de IA, a integração estreita entre a camada conversacional e as ferramentas de automação acaba eliminando essas barreiras críticas.

Esse risco é ainda maior em ambientes de criptomoedas, onde as transações são executadas quase instantaneamente, ficam visíveis publicamente e são praticamente impossíveis de reverter após a confirmação.

O caso mostrou como uma única resposta de IA pode se transformar em comandos executáveis para sistemas de carteiras conectadas. Especialistas em segurança chamam isso de “cadeia de confiança de agentes”, em que pequenas manipulações ou interpretações equivocadas podem rapidamente resultar em perdas reais.

Você sabia? O código Morse, criado na década de 1830, ainda pode ser interpretado por sistemas modernos de IA treinados em padrões de texto.

Por que agentes de IA voltados para criptomoedas podem ser especialmente vulneráveis

O DeFi (finanças descentralizadas) já enfrenta phishing, malware, sites falsos e engenharia social. Agentes de IA adicionam uma nova camada de ameaça porque conseguem ler, interpretar e agir de forma independente com base em informações de fontes não verificadas.

Isso cria diversos desafios específicos:

Agentes de IA conseguem analisar e processar rapidamente grandes volumes de dados públicos.

Sistemas conectados a carteiras frequentemente operam em ambientes online abertos e não confiáveis.

A automação permite execuções quase instantâneas sem supervisão humana.

Interações cotidianas, como respostas, menções ou publicações codificadas, podem se tornar potenciais pontos de entrada.

Problemas podem se multiplicar e se espalhar antes mesmo que alguém perceba irregularidades.

Sistemas bancários tradicionais normalmente exigem várias camadas de aprovação humana ou institucional antes da movimentação de fundos. Em contraste, plataformas com agentes de IA costumam priorizar velocidade e autonomia. Quando isso é combinado com a irreversibilidade das criptomoedas, até pequenos erros ou manipulações bem-sucedidas podem causar danos financeiros significativos.

Você sabia? Agentes de IA já estão sendo testados para trading, gerenciamento de carteiras e suporte à governança de organizações autônomas descentralizadas (DAOs).

Por que esse caso importa além de um único incidente

Embora o episódio relatado envolva uma carteira Bankr conectada ao Grok, a vulnerabilidade central afeta todo o ecossistema de ferramentas cripto movidas por IA.

Diversos projetos estão correndo para desenvolver carteiras inteligentes, bots de trading autônomos, assistentes de DeFi e agentes integrados às redes sociais. O apelo é evidente: permitir que usuários controlem ações na blockchain usando linguagem comum, sem precisar lidar diretamente com detalhes técnicos das transações.

No entanto, cada nova camada de automação cria novos pontos de confiança que podem ser explorados. Quando uma IA consegue analisar mensagens, interpretar comandos e iniciar diretamente ações em carteiras, invasores passam a ter múltiplos vetores de ataque. Isso não se limita a um único provedor de IA, projeto ou blockchain específica.

O risco mais amplo está no excesso de autonomia concedido à IA: dar a esses sistemas mais poder de decisão do que conseguem administrar com segurança. Muitos especialistas em segurança defendem atualmente que a IA deve auxiliar os usuários, e não substituir completamente a supervisão humana e a aprovação explícita.

Lições que desenvolvedores de criptomoedas podem aprender com o incidente

O episódio oferece diversos aprendizados práticos para equipes que desenvolvem produtos blockchain integrados com IA:

Manter uma separação clara entre a análise feita pela IA e a movimentação real de fundos. O sistema responsável por ler e resumir informações não deve estar dentro da mesma camada de segurança do sistema que executa transações.

Exigir etapas extras de confirmação ou verificações humanas para transferências significativas. Embora a automação aumente a velocidade, conceder liberdade irrestrita a ela pode expor toda a plataforma a perdas severas.

Implementar estruturas robustas de permissões, como limites de transação, listas de endereços autorizados e atrasos temporais para operações críticas.

Ter extremo cuidado durante atualizações e alterações de código. Proteções que antes restringiam ações acionadas por IA podem enfraquecer ou desaparecer acidentalmente, mostrando como essas salvaguardas podem ser delicadas.

Sempre tratar respostas de modelos de IA como potencialmente não verificadas. Nenhuma resposta de IA deveria ser aceita automaticamente como um comando confiável para ações financeiras.

Lições que usuários de criptomoedas podem aprender com o incidente

Usuários comuns também podem tirar conclusões importantes do ocorrido:

À medida que carteiras inteligentes e assistentes de IA se tornam mais comuns, os usuários precisam pensar em segurança de uma nova forma. Proteger seus ativos envolverá mais do que apenas guardar frases-semente ou evitar golpes óbvios. Também será necessário monitorar aplicativos conectados, permissões concedidas e comportamentos automatizados.

É importante ter cautela extra com soluções de agentes de IA ainda experimentais, especialmente quando elas controlam valores elevados. Distribuir fundos entre diferentes carteiras pode ajudar a limitar danos caso alguma ferramenta apresente falhas.

Preste atenção aos direitos e capacidades que NFTs aparentemente simples, tokens de associação ou aplicativos conectados realmente oferecem. Um colecionável gratuito pode liberar muito mais poder operacional do que aparenta.

Entenda que a IA pode interpretar situações de forma equivocada, ignorar contextos importantes ou agir de maneira inesperada quando exposta a ambientes online abertos. Permanecer vigilante continua sendo essencial, mesmo à medida que essas ferramentas se tornam mais convenientes.